科(kē)技(jì )界永遠(yuǎn)不缺乏驚喜,北京時間3月19日淩晨,全球芯片巨頭英偉達(NVIDIA)公(gōng)司召開了一年一度的 GTC 大會,公(gōng)司創始人兼首席執行官黃仁勳發表演講,正式宣布将推出用(yòng)于萬億參數級生成式AI的NVIDIA Blackwell架構及搭載Blackwell技(jì )術的B200和GB200系列芯片,将人工(gōng)智能(néng)的計算能(néng)力推向了前所未有(yǒu)的高度。

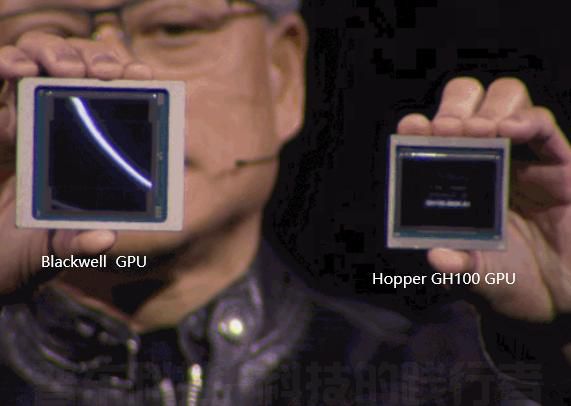

在規格和性能(néng)方面,英偉達的新(xīn)一代超級AI芯片顯示出顯著的進步。據會上介紹,上一代H100/H200芯片有(yǒu)800億個晶體(tǐ)管,而B200擁有(yǒu)2080億個晶體(tǐ)管。晶體(tǐ)管是集成電(diàn)路的基本組件,更多(duō)的晶體(tǐ)管可(kě)以處理(lǐ)更多(duō)的數據,執行更複雜的計算,從而提供更高的性能(néng)。B200采用(yòng)允許更小(xiǎo)的晶體(tǐ)管尺寸和更高的集成度的台積電(diàn)4NP工(gōng)藝制程,可(kě)以支持多(duō)達10萬億個參數的AI大模型來進行更高級的自然語言處理(lǐ)、圖像識别和複雜的數據分(fēn)析任務(wù)。GB200芯片将兩個B200 Blackwell GPU與一個基于Arm架構的Grace CPU進行配對,兩塊芯片之間的互聯速度高達10TBps,這種設計結合了GPU的強大并行處理(lǐ)能(néng)力和CPU的高效序列處理(lǐ)能(néng)力。

黃仁勳展示兩代GPU

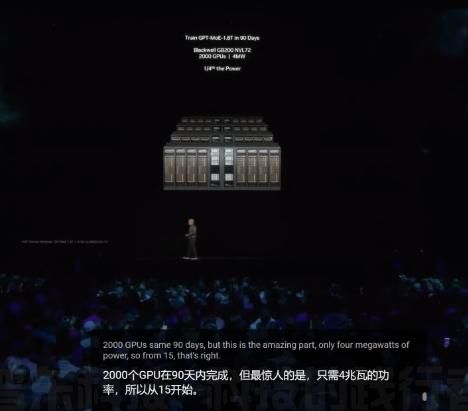

在能(néng)效方面,Blackwell芯片架構也有(yǒu)顯著改進,黃仁勳舉例如果要訓練一個1.8萬億參數量的GPT模型,在沒有(yǒu)使用(yòng)Blackwell技(jì )術的情況下,需要連續運行90天,使用(yòng)8000張Hopper GPU,并消耗15兆瓦的電(diàn)力。但如果使用(yòng)了Blackwell GPU,隻需要2000張芯片,而且隻需消耗四分(fēn)之一的電(diàn)力,大約4兆瓦,就可(kě)以完成同樣的任務(wù)。Blackwell芯片架構的能(néng)效改進意味着在處理(lǐ)大規模AI模型訓練時,可(kě)以實現更高的性能(néng)和更低的能(néng)源消耗,這對于可(kě)持續發展具(jù)有(yǒu)重要意義。

黃仁勳對于Blackwell能(néng)耗的解釋

在當前人工(gōng)智能(néng)快速發展的背景下,對于計算能(néng)力的需求也日益增長(cháng)。從自動駕駛汽車(chē)到智能(néng)醫(yī)療診斷,再到大規模數據分(fēn)析、數字孿生等,沒有(yǒu)哪一項不在渴求更高的處理(lǐ)速度和更低的能(néng)耗。英偉達的這次技(jì )術革新(xīn),将會獲得更多(duō)的合作(zuò)。會上,黃仁勳提到台積電(diàn)和Synopsys已将 NVIDIA cuLitho集成到其軟件、制造工(gōng)藝和系統中(zhōng),多(duō)家頭部電(diàn)動汽車(chē)制造商(shāng)也将采用(yòng)英偉達集中(zhōng)式車(chē)載計算平台DRIVE Thor開發下一代AI電(diàn)動車(chē)等。

英偉達的合作(zuò)夥伴

随着英偉達Blackwell的發布,預示着我們步入了一個AI算力大幅度提升的新(xīn)紀元。這不僅僅是一個産(chǎn)品的發布,更是一個行業的變革,是對未來世界的重新(xīn)想象。

(大衆日報·大衆新(xīn)聞客戶端記者 李姝蒙 策劃 湯代祿)

免責聲明:普東科(kē)技(jì )遵守行業規則,本站所轉載的稿件都标注作(zuò)者和來源。 轉載稿件或作(zuò)者投稿可(kě)能(néng)會經編輯修改或者補充. 如有(yǒu)異議可(kě)投訴至: infopd@bjpudong.com.cn